Contar con una presencia digital sólida es hoy indispensable para cualquier proyecto, y la gestión adecuada del archivo robots.txt en un sitio web se ha convertido en una herramienta clave para garantizar el control sobre cómo los buscadores y, ahora, los rastreadores de Inteligencia Artificial (IA) interactúan con el contenido publicado.

El archivo robots.txt es un documento de texto sencillo ubicado en el directorio raíz de una página web (por ejemplo, www.tusitio.com/robots.txt) que actúa como una serie de instrucciones dirigidas a los rastreadores o “bots” que recorren Internet. En él se puede indicar qué partes del sitio deben ser ignoradas por los motores de búsqueda, aunque no se trata de un mecanismo de seguridad, sino de una recomendación pública que cualquier persona o bot puede consultar.

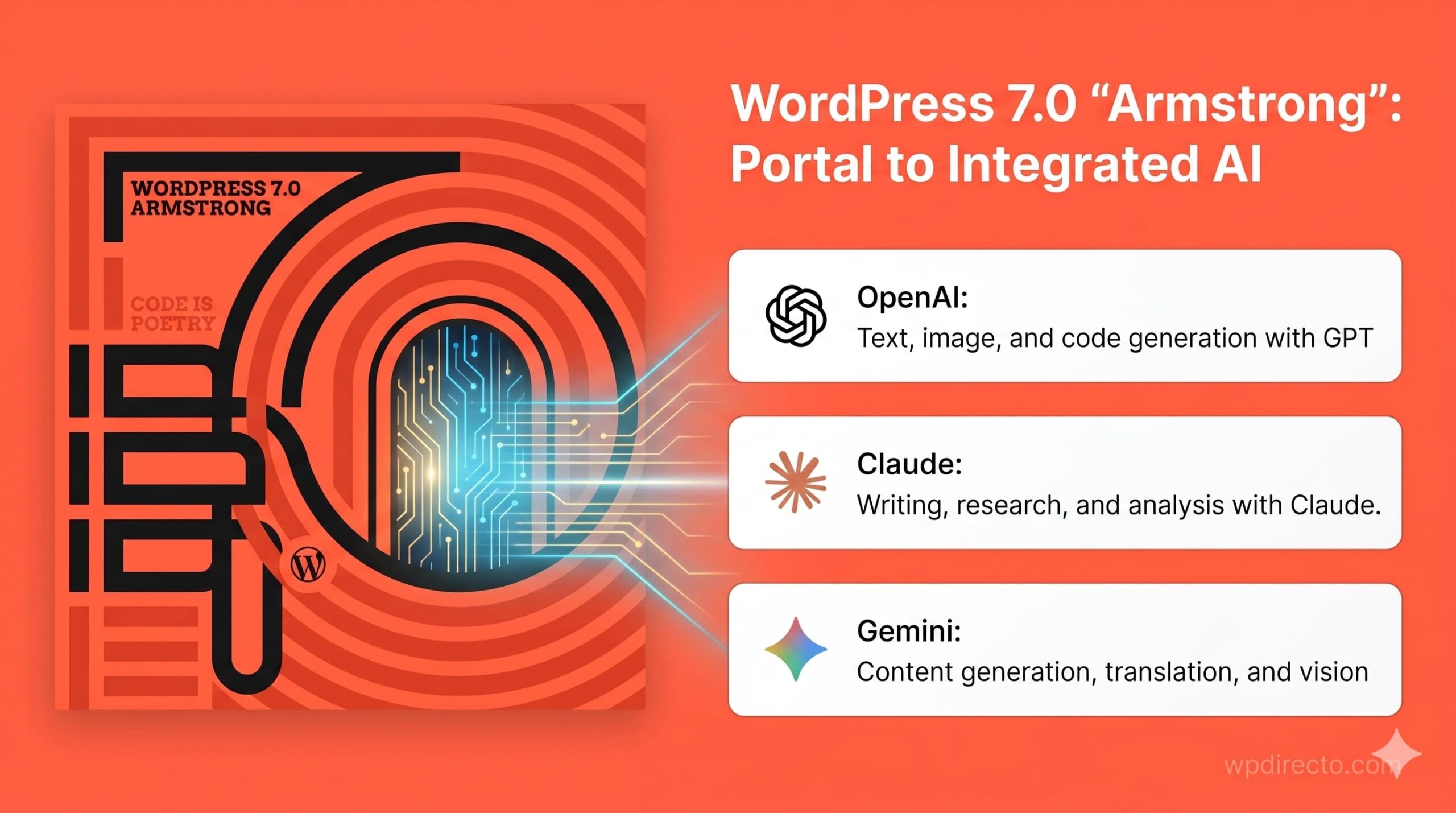

Tradicionalmente, el robots.txt ha servido para evitar la indexación de contenido duplicado, bloquear accesos a directorios sensibles o poco relevantes, conservar el presupuesto de rastreo y señalar la ubicación del sitemap. Sin embargo, con la irrupción de los rastreadores de IA, su papel se ha reforzado, permitiendo a los administradores de sitios web decidir si desean o no que sus contenidos sean utilizados para entrenar modelos de lenguaje como ChatGPT o Claude.

La gestión de este archivo resulta, por tanto, más importante que nunca. No solo por una cuestión de SEO y control de indexación, sino también por el impacto que puede tener sobre la privacidad de los datos y la propiedad intelectual.

Existen dos métodos principales para modificar este archivo en una instalación de WordPress: hacerlo mediante un plugin o de forma manual a través del servidor.

Esta es la opción más recomendable para la mayoría de los usuarios, especialmente para quienes no cuentan con conocimientos técnicos avanzados. Plugins de SEO populares como Yoast SEO, Rank Math o SEOPress incluyen editores integrados de robots.txt.

La ventaja radica en su interfaz amigable, con validación de sintaxis y opciones de reversión. Una vez realizados los cambios, es recomendable probar el archivo mediante la herramienta de test de robots.txt de Google Search Console.

Para usuarios más avanzados, también es posible editar el archivo directamente desde el servidor. Esto puede realizarse mediante gestores de archivos en cPanel, conexiones FTP o SSH. Si el archivo no existe, puede crearse desde cero en el directorio raíz de la instalación de WordPress.

Esta alternativa ofrece control total sobre la configuración, aunque también implica un mayor riesgo de errores. Por ello, tras realizar modificaciones, se recomienda siempre verificar el funcionamiento con la herramienta de prueba de Google.

Uno de los apartados que más atención está despertando es la posibilidad de gestionar el acceso de los bots de IA a través de este archivo. Por ejemplo, OpenAI ofrece información pública sobre sus rastreadores:

makefileCopiarEditarUser-agent: GPTBot

Disallow: /

makefileCopiarEditarUser-agent: OAI-SearchBot

Allow: /

De esta forma, se puede combinar un control total sobre qué contenidos pueden ser rastreados por buscadores tradicionales y qué partes estarán disponibles para los sistemas de IA.

En un entorno donde los datos se han convertido en materia prima para los modelos de IA, cada vez son más los administradores web que desean limitar la extracción masiva de información. Además de proteger recursos, se evita contribuir al entrenamiento de modelos sin consentimiento.

El robots.txt no es infalible —pues rastreadores maliciosos pueden ignorarlo—, pero sigue siendo una señal clara que los buscadores legítimos suelen respetar. Por tanto, su correcta configuración es una herramienta indispensable para cualquier sitio web preocupado por su contenido y privacidad.

Los expertos aconsejan revisar y actualizar el archivo robots.txt cada vez que se realicen cambios significativos en la estructura de la web. Además, se recuerda que no es un sistema de seguridad y que, para proteger datos sensibles, deben implementarse medidas adicionales de autenticación y autorización.

En la era digital actual, donde motores de búsqueda y sistemas de IA recorren la red sin descanso, el robots.txt es más que nunca una puerta que conviene saber abrir y cerrar con criterio.